Prin Machine Learning (ML) și Deep Learning (DL) creăm sisteme pe care nu le cunoaștem încă pe deplin. Legiuitorul european a devenit conștient de această capcană și poate cea mai inovatoare și orientată spre viitor din Regulamentul general privind protecția datelor (GDPR), noul regulament privind confidențialitatea care a intrat în vigoare în Europa pe 25 mai 2018, este tocmai dreptul la explicație sau dreptul de a obține informații semnificative despre logica adoptată de orice sistem automat de decizie care are efecte juridice, sau „similar de relevant”, pentru persoanele implicate. Fără o tehnologie capabilă să explice logica cutiilor negre, totuși, dreptul la explicație este destinat să rămână o literă moartă sau să interzică multe aplicații ale ML opace. Nu este vorba doar de etică digitală, de evitarea discriminării și a nedreptății, ci și de securitate și responsabilitate corporativă. În domenii precum autoturisme, asistenți robotici, sisteme IoT de automatizare și fabricare a casei, medicamente de precizie personalizate, companiile lansează servicii și produse cu componente AI care ar putea încorpora din greșeală decizii eronate, cruciale pentru siguranță, învățate din erori sau prin corelații false în datele de învățare. De exemplu, cum să recunoașteți un obiect într-o fotografie după proprietățile nu ale obiectului în sine, ci ale proprietăților fundalului, datorită unei părtiniri sistematice în colecția de exemple de învățare. Cum pot companiile să aibă încredere în produsele lor fără să înțeleagă și să își valideze funcționarea? Tehnologia AI explicabilă este esențială pentru a crea produse cu componente AI fiabile, pentru a proteja siguranța consumatorilor și pentru a limita răspunderea industrială. În consecință, utilizarea științifică a ML, ca și în medicină, biologie, economie sau științe sociale, necesită o înțelegere nu numai pentru încrederea în rezultate, ci și pentru natura deschisă a cercetării științifice, astfel încât să poată fi împărtășită și să progreseze. Provocarea este dură și stimulantă: o explicație nu trebuie doar să fie corectă și exhaustivă, ci și de înțeles pentru o multitudine de subiecți cu nevoi și competențe diferite, de la utilizatorul care face obiectul unei decizii, la dezvoltatorii de soluții AI, la cercetători, la specialiști în știința datelor, factori de decizie politică, autorități de supraveghere, asociații pentru drepturile civile, jurnaliști.

Ce este o „explicație” a fost deja investigat de Aristotel în Fizica sa, un tratat datând din secolul al IV-lea î.e.n. Astăzi este urgent să dăm un sens funcțional, ca o interfață între oameni și algoritmii care sugerează decizii, sau care decid direct, astfel încât AI să servească pentru a spori capacitățile umane, nu pentru a le înlocui. În general, abordările explicative diferă pentru diferitele tipuri de date din care doriți să învățați un model. De exemplu, pentru datele tabulare, metodele de explicație încearcă să identifice care sunt variabilele care contribuie la o decizie specifică sau la o predicție sub forma unor reguli dacă-atunci-altfel, sau a arborilor de decizie.

În ultimii doi ani a existat un efort impetuos de cercetare privind inteligența artificială inteligibilă, dar nu a apărut încă o tehnologie pentru explicația practică și aplicabilă sistematic. Există două modalități largi de a rezolva problema:

- explicație prin proiectare: (explanation by-design, XbD). Având în vedere un set de date de decizie, cum să construim un „factor de decizie automat transparent” care să ofere sugestii ușor de înțeles;

- explicația casetelor negre: (explanation of the black-boxes, Bbx). Având în vedere un set de decizii produse de un „factor de decizie automat opac”, cum să reconstituim o explicație pentru fiecare decizie.

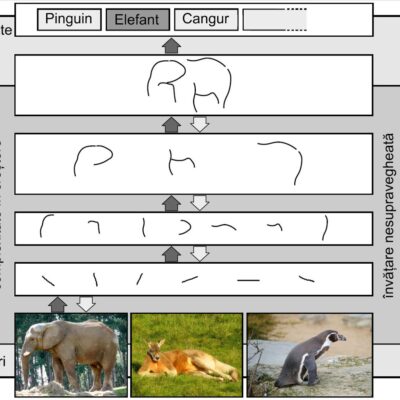

Cele mai recente lucrări din literatură sunt discutate în recenzie (10), organizându-le în conformitate cu ontologia ilustrată în figura de mai jos. Astăzi avem rezultate încurajatoare care ne permit să reconstituim explicații individuale, răspunsuri la întrebări precum „De ce nu am fost ales pentru locul pentru care am solicitat? Ce ar trebui să schimb pentru a răsturna decizia?”

Figura 1: Problemele deschiderii cutiei negre

Sursa: Guidotti et al., 2018. Acces online deschis la: https://dl.acm.org/doi/10.1145/3236009

Prima distincție se referă la XbD și Bbx. Aceasta din urmă poate fi împărțit în continuare între Explicația modelului, atunci când scopul explicației este întreaga logică a modelului întunecat, Explicația rezultatului, când scopul este de a explica deciziile despre un anumit caz, și Inspecția modelului, când scopul este să înțelegeți general proprietățile modelului întunecat.

Evoluăm rapid dintr-un moment în care oamenii codificau algoritmi, asumându-și responsabilitatea pentru corectitudinea și calitatea software-ului produs și alegerile reprezentate în acesta, într-un moment în care mașinile deduc în mod independent algoritmi pe baza unui număr suficient de exemple de intrare așteptată / comportamentul de ieșire. În acest scenariu perturbator, ideea cutiilor negre ale AI care sunt deschise și ușor de înțeles este funcțională nu numai pentru a verifica corectitudinea și calitatea lor, ci mai ales pentru a alinia algoritmii cu valorile și așteptările umane și pentru a păstra sau, eventual, pentru a extinde, autonomia și conștientizarea deciziilor noastre (11).

Note

(10) R. Guidotti et al., A survey of methods for explaining black box models, ACM computing surveys (CSUR) 2018, pp. 1-42

(11) D. Pedreschi et al., Meaningful explanations of Black Box AI decision systems. Proceedings of the 33rd AAAI Conference on Artificial Intelligence 2019, 9780-9784

Sursa: Pedreschi, D., Artificial Intelligence (AI): new developments and innovations applied to e-commerce, Study for the committee on the Internal Market and Consumer Protection, Policy Department for Economic, Scientific and Quality of Life Policies, European Parliament, Luxembourg, 2020. © European Union, 2020. Traducere și adaptare independentă: Nicolae Sfetcu

© 2021 MultiMedia Publishing, Introducere în inteligența artificială

Lasă un răspuns